XELA机器人三轴力触觉传感器授权伙伴——欣佰特科技(北京)有限公司

电话:18001131966 Email: sales@cnbytec.com

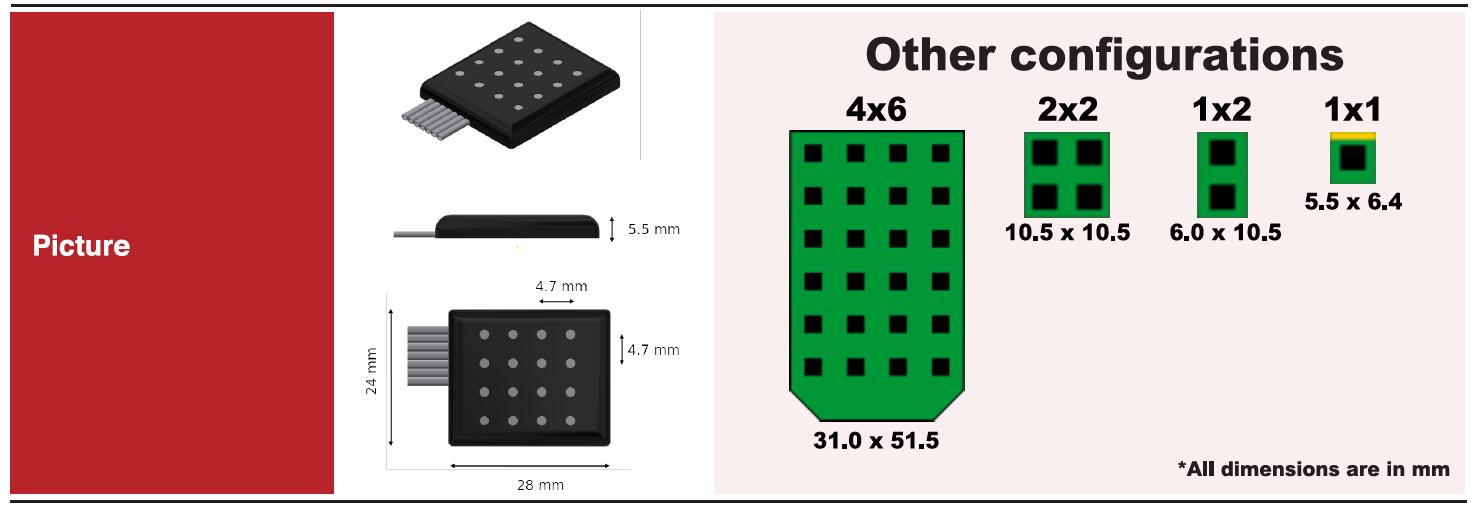

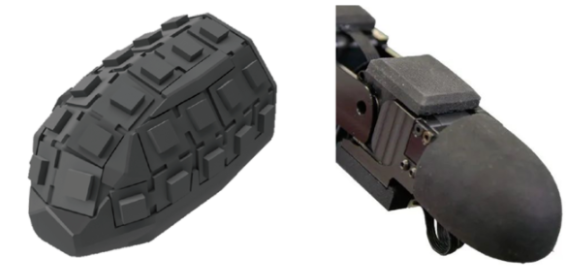

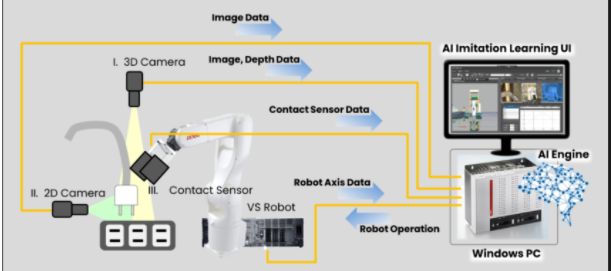

XELA的3轴力传感器阵列,用于实现机器手和夹爪的触觉感知。XELA触觉感应阵列,具有小巧、轻薄、柔软、耐用,布线少等优点。Uskin传感器阵列具有1×1、2×1、2×2、4×4、4×6多种规格。

提供数字输出,只需要几根细线,不需额外模数转换器。提供更快、更精确的测量,同时将电噪声和干扰降至最低。

这是一种柔软传感器,能够处理易碎物体而不会损坏它们。不同尺寸、形状、硬度和重量的物体可以可靠地抓握和操作。柔软性还可确保传感器对过载具有高度的弹性,使其非常耐用。

XELA提供触觉皮肤传感器,可轻松集成,以简单地粘附或连接方式进行安装。

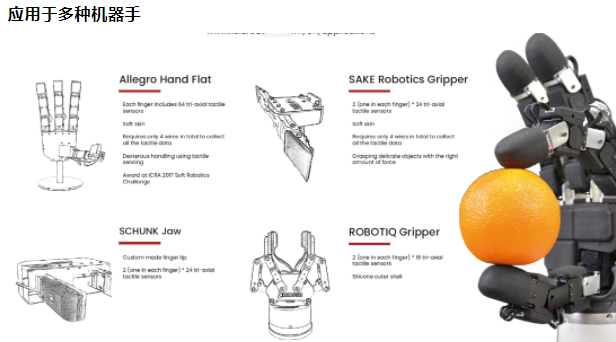

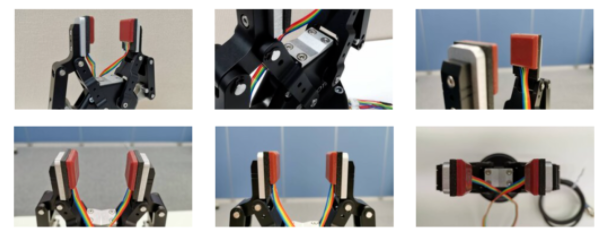

uSkin可以和SCHUNK等各种平行夹爪集成。uSkin设计了一个定制的指尖,可以安装在Schunk、Weiss、Onrobot等各种平行夹爪上。

这款定制的指尖,完全适合uSkin的所有组件,并完全固定和覆盖我们的传感器。

将SAKE机器人手爪与uSkin相结合,使其能够精确地抓取和操纵物体。

XELA uSkin可以集成到ROBOTIQ手爪上。uSkin传感器可以针对每个特定应用进行修改。对于这个特殊的应用,我们将传感器的外壳从普通的夹持胶带改为硅胶外层。硅层确保了客户研究所需的平坦表面。

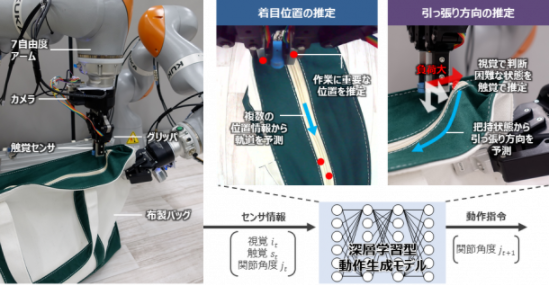

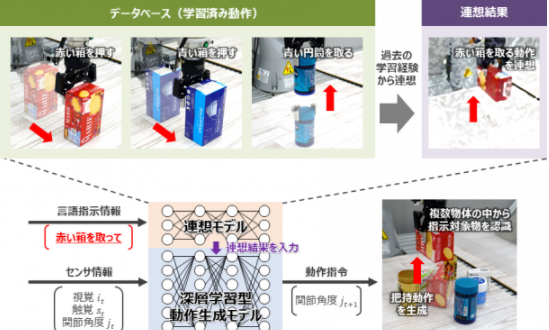

文稿来源:https://www.waseda.jp/top/news/73068